A-Parser Support

Активный пользователь

- Регистрация

- 03.06.2013

- Сообщения

- 347

- Реакции

- 32

- Баллы

- 28

Сборник статей #11: анализ содержимого картинок, добавление ссылок в индекс Google и поиск RSS лент

11-й сборник статей, в котором рассказано, как в А-Парсере анализировать содержимое картинок, добавлять страницы своих сайтов в индекс Google и искать RSS ленты необходимой тематики.

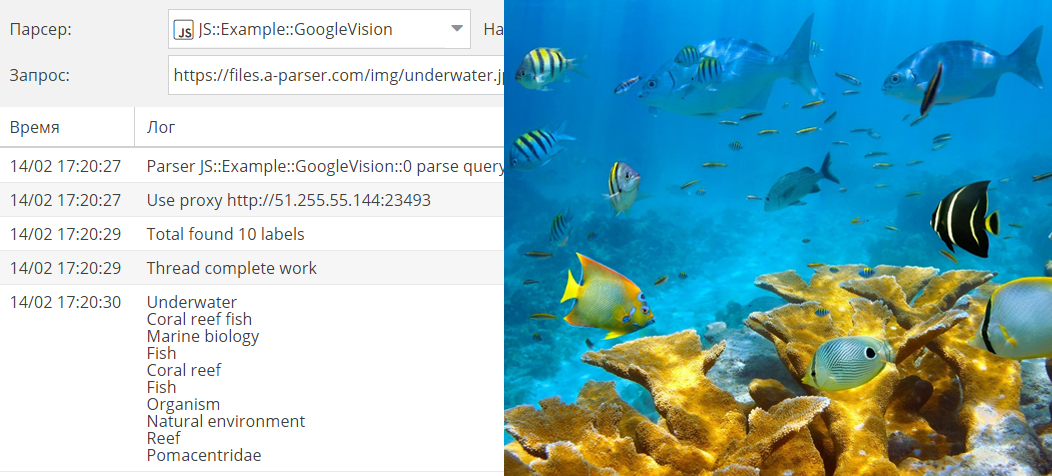

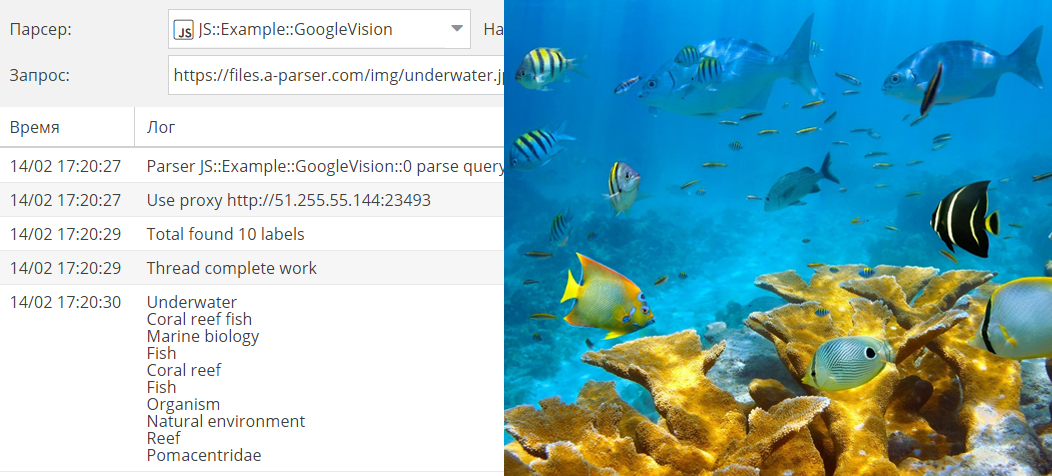

Фильтрация картинок по их содержимому

В этой статье на примере поиска картинок с определенным содержимым, показана работа с Google Vision. С помощью "компьютерного зрения" для каждого изображения присваивается набор меток, который описывает содержимое.

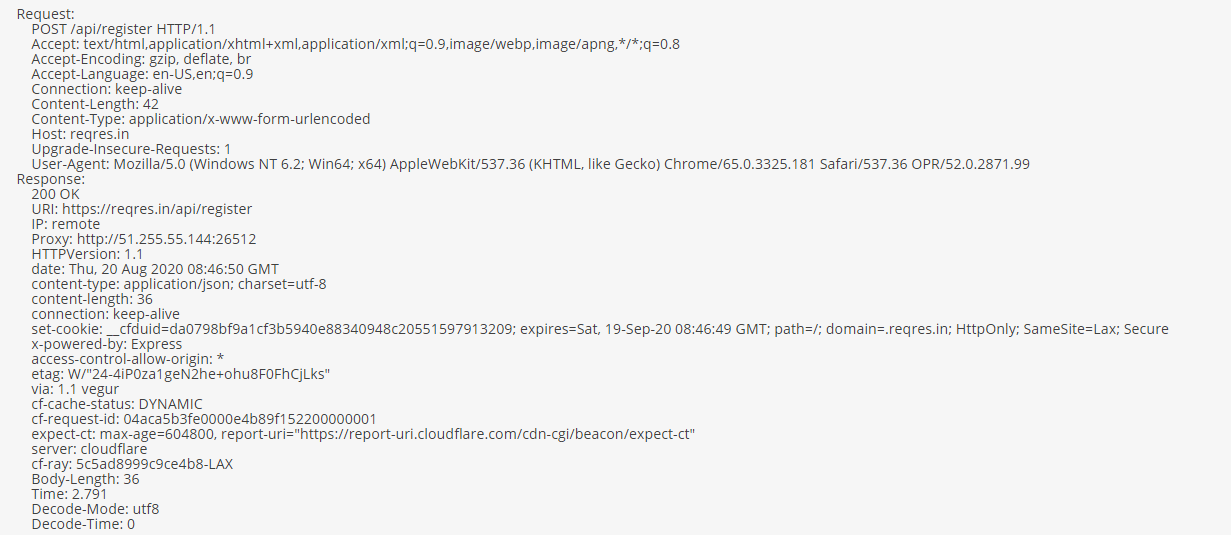

Инструкция по использованию Google Indexing API

В данной статье рассмотрена работа с Google Indexing API, который позволяет владельцам сайтов напрямую уведомлять Google о добавлении или удалении страниц. Таким образом ваш сайт будет быстрее просканирован Google, что способствует повышению качества трафика.

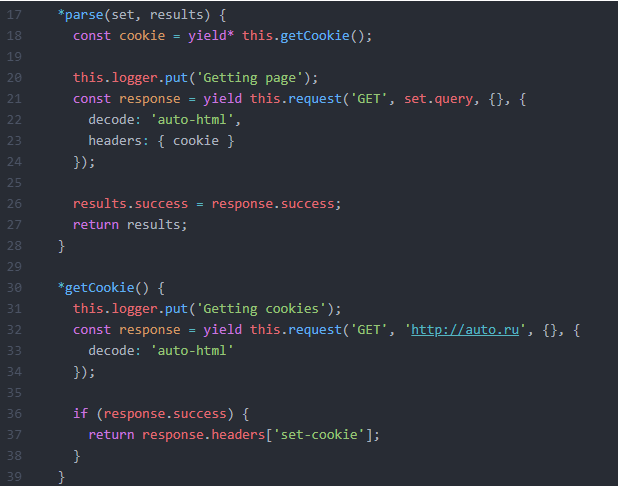

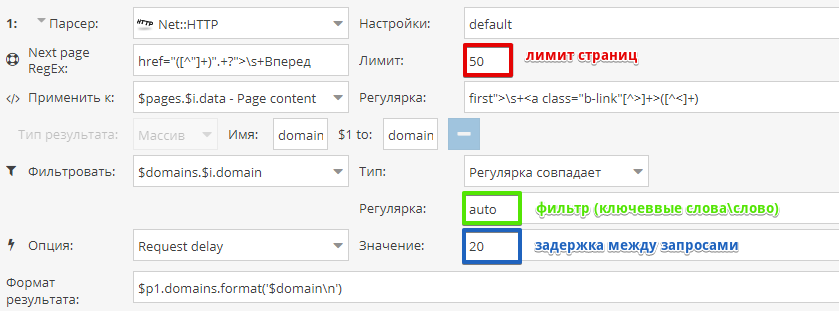

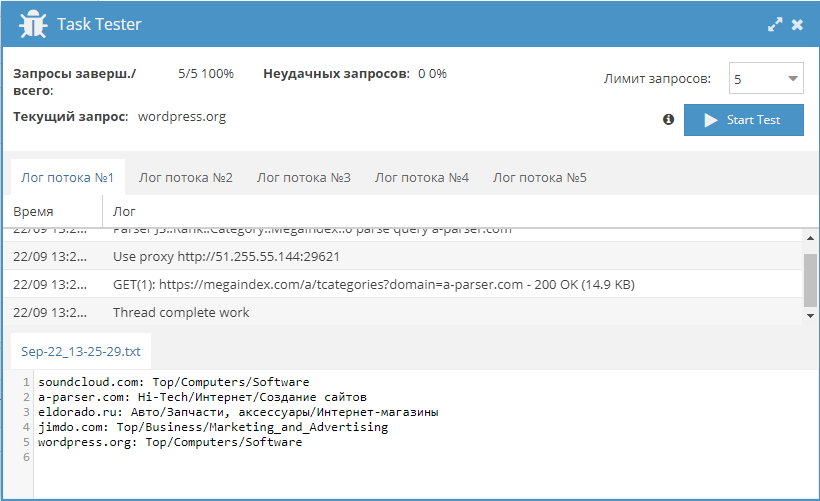

Поиск и сбор rss лент

В этой статье рассмотрен простой пример поиска ссылок на rss ленты по заданной тематике. Решение состоит из 3-х пресетов, каждый из которых отвечает за определенный этап работы.

Если вы хотите, чтобы мы более подробно раскрыли какой-то функционал парсера, у вас есть идеи для новых статей или вы желаете поделиться собственным опытом использования A-Parser (за небольшие плюшки ) - отписывайтесь здесь.

) - отписывайтесь здесь.

Подписывайтесь на наш канал на Youtube - там регулярно выкладываются видео с примерами использования A-Parser, а также следите за новостями в Twitter.

Все сборники статей

11-й сборник статей, в котором рассказано, как в А-Парсере анализировать содержимое картинок, добавлять страницы своих сайтов в индекс Google и искать RSS ленты необходимой тематики.

Фильтрация картинок по их содержимому

В этой статье на примере поиска картинок с определенным содержимым, показана работа с Google Vision. С помощью "компьютерного зрения" для каждого изображения присваивается набор меток, который описывает содержимое.

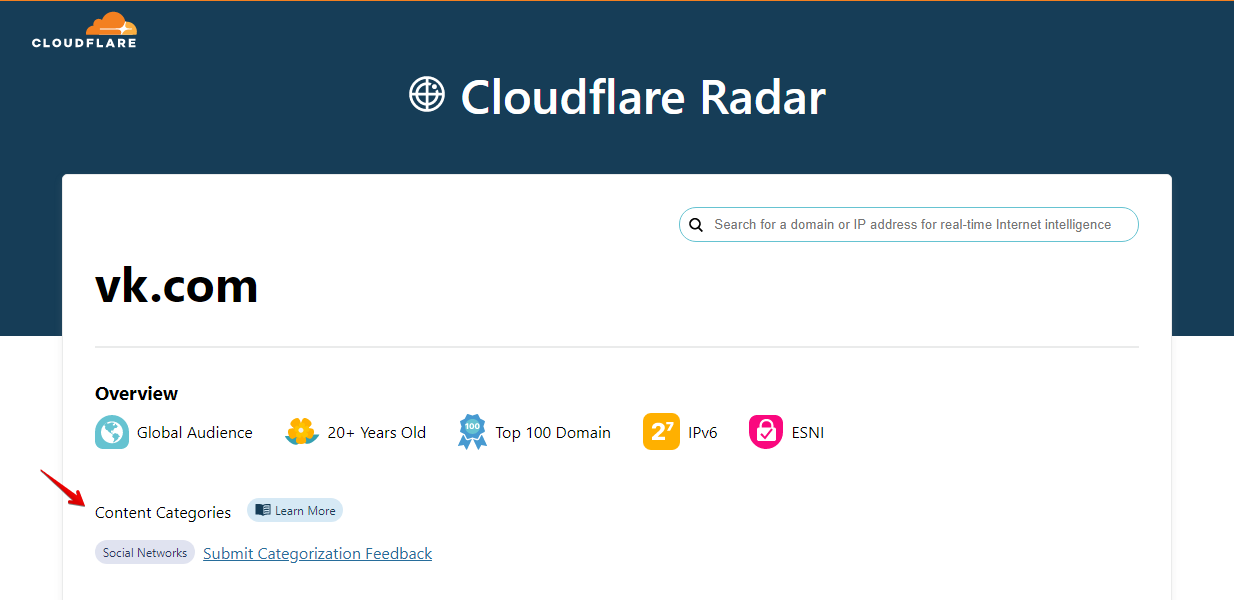

Инструкция по использованию Google Indexing API

В данной статье рассмотрена работа с Google Indexing API, который позволяет владельцам сайтов напрямую уведомлять Google о добавлении или удалении страниц. Таким образом ваш сайт будет быстрее просканирован Google, что способствует повышению качества трафика.

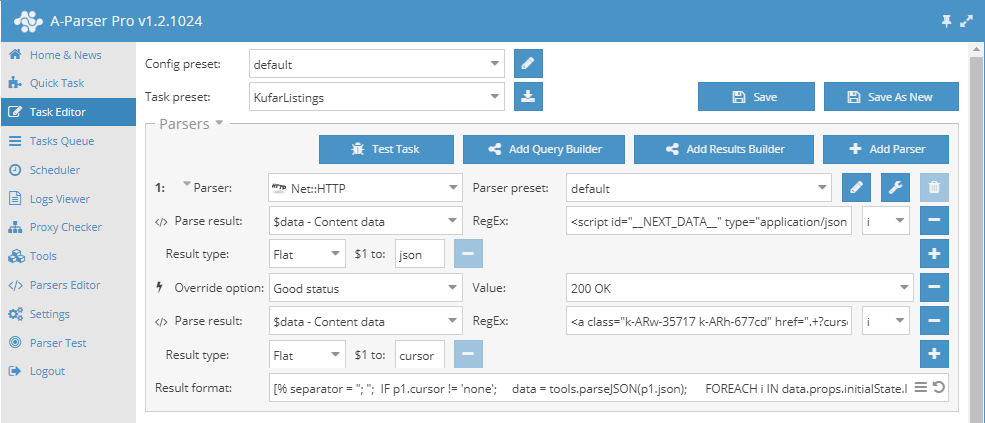

Поиск и сбор rss лент

В этой статье рассмотрен простой пример поиска ссылок на rss ленты по заданной тематике. Решение состоит из 3-х пресетов, каждый из которых отвечает за определенный этап работы.

Если вы хотите, чтобы мы более подробно раскрыли какой-то функционал парсера, у вас есть идеи для новых статей или вы желаете поделиться собственным опытом использования A-Parser (за небольшие плюшки

) - отписывайтесь здесь.

) - отписывайтесь здесь.Подписывайтесь на наш канал на Youtube - там регулярно выкладываются видео с примерами использования A-Parser, а также следите за новостями в Twitter.

Все сборники статей

SE::Yandex::ByImage

SE::Yandex::ByImage Social::Instagram::post

Social::Instagram::post Util::YandexRecognize

Util::YandexRecognize SE::Yandex::SQI

SE::Yandex::SQI HTML::EmailExtractor

HTML::EmailExtractor SE::Google::Trends

SE::Google::Trends SE::Seznam

SE::Seznam SE::Yandex

SE::Yandex SE::Yandex:: Direct

SE::Yandex:: Direct SE::Bing::LangDetect

SE::Bing::LangDetect Rank::Ahrefs

Rank::Ahrefs SE::Bing

SE::Bing SE::Startpage

SE::Startpage Shop::eBay

Shop::eBay SE::Yahoo

SE::Yahoo  SE::Google::Images

SE::Google::Images Net::HTTP

Net::HTTP

![[IMG] [IMG]](https://files.a-parser.com/img/1.2.852.png)

uckDuckGo

uckDuckGo ost

ost

![[IMG] [IMG]](https://files.a-parser.com/img/site/tg_chat_btn.png#1500)

![[IMG] [IMG]](https://files.a-parser.com/img/A-Parser__Advanced_SE_Parser_%26_Analyze_tool_-_Google_Chrome_2020-04-27_11.43.26.png)

![[IMG] [IMG]](https://files.a-parser.com/img/dnr3e_200427125510.png)

![[IMG] [IMG]](https://files.a-parser.com/img/fwrq2_200427130816.png)

![[IMG] [IMG]](https://files.a-parser.com/img/button_a-parser_small_1500.png)