1. Сначала заново распаковал твой архив и заново скомпиллировал .exe. Попробовал прогнать через readability_example.xmlz, он выдал ошибку, как у коллеги выше:

2. Скопировал содержимое обоих проектов в одноименные файлы и сохранил из своей версии зенно - тот же результат, как у меня выше.

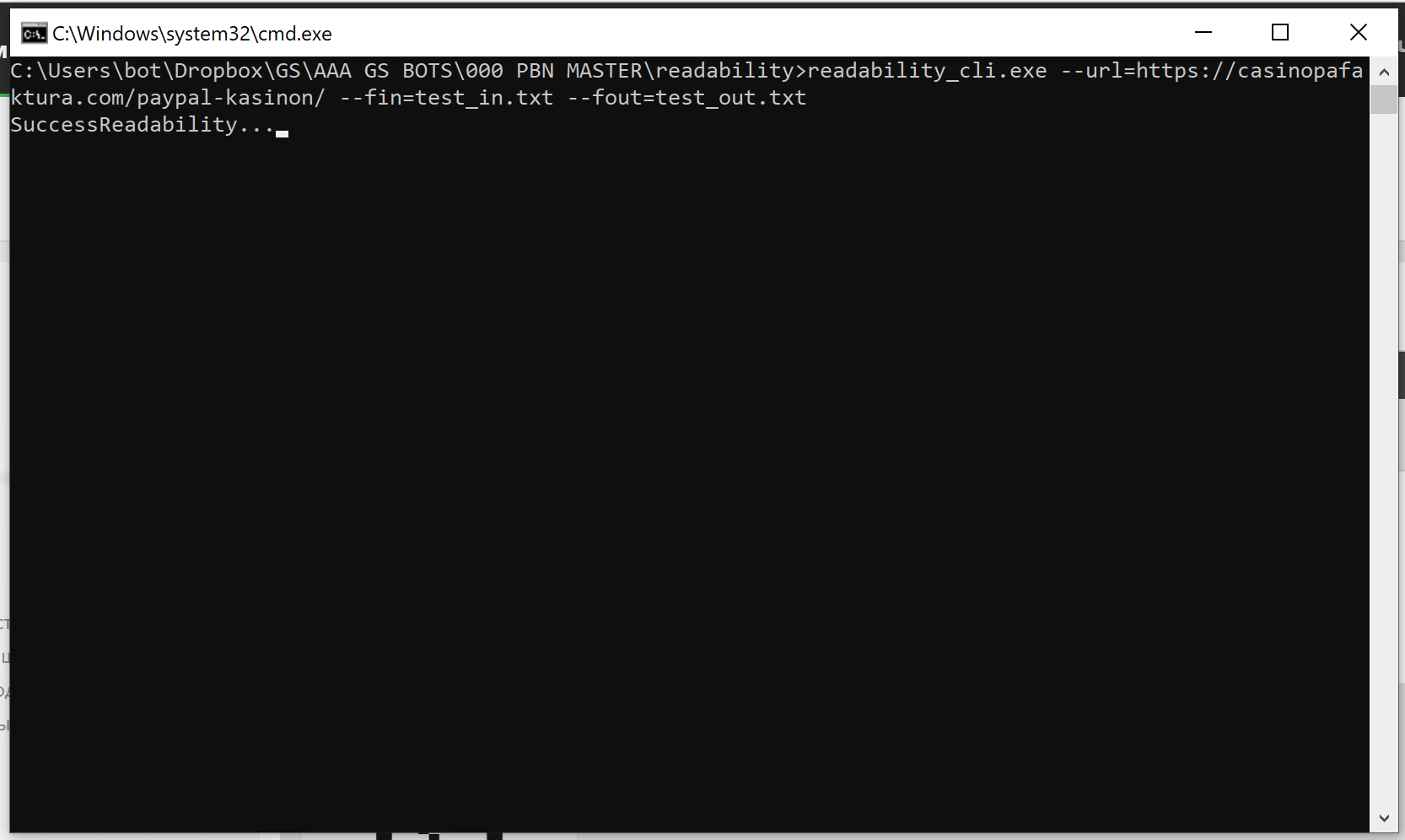

3. Прогнал батник, который странным образом (?) пропарсил мой урл, который я пытался спрятать в скриншоте выше Глюк, или ты его вписал?

Глюк, или ты его вписал?

Получилось, кажется, что успех рядом:

2. Скопировал содержимое обоих проектов в одноименные файлы и сохранил из своей версии зенно - тот же результат, как у меня выше.

3. Прогнал батник, который странным образом (?) пропарсил мой урл, который я пытался спрятать в скриншоте выше

Глюк, или ты его вписал?

Глюк, или ты его вписал?Получилось, кажется, что успех рядом: