Вы используете устаревший браузер. Этот и другие сайты могут отображаться в нём некорректно.

Вам необходимо обновить браузер или попробовать использовать другой.

Вам необходимо обновить браузер или попробовать использовать другой.

WebArchiveMaster - парсер Вебархива

- Автор темы footashes

- Дата начала

- Статус

- В этой теме нельзя размещать новые ответы.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

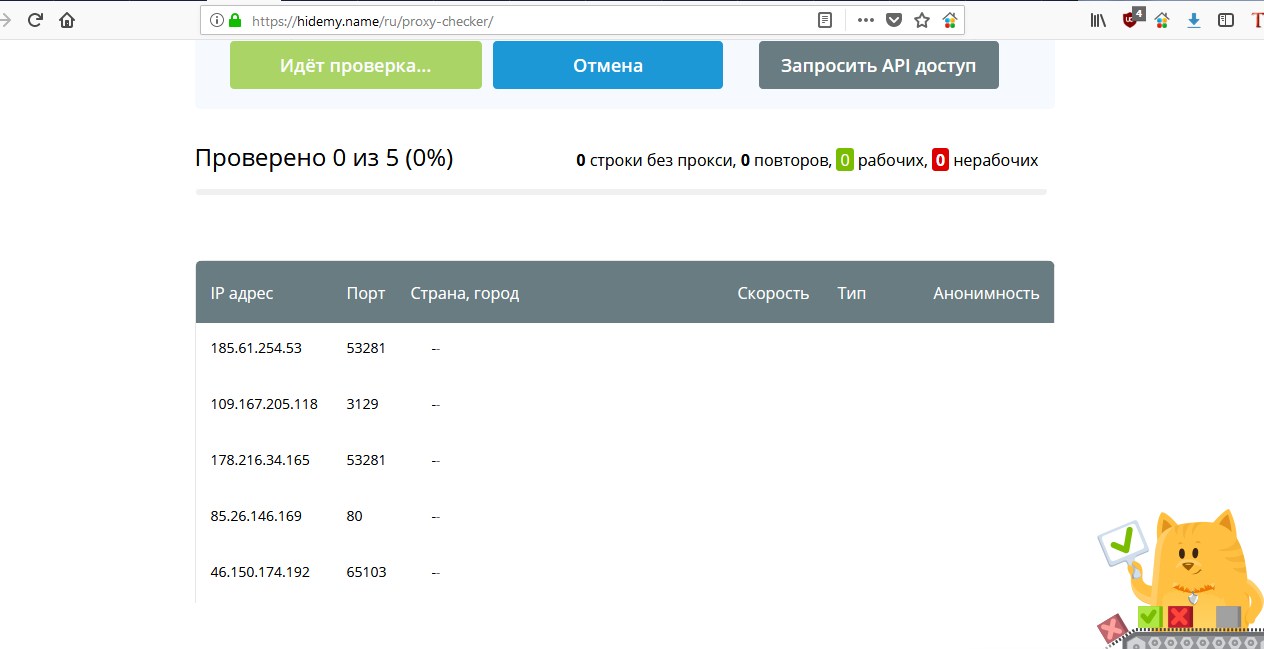

Вы получили сегодня обновление? Последнее обновление решает эту проблему. Дело в том, что проверка чекера прокси вызывало зависание из-за самого зависания сервиса (такое не было предусмотрено, так-как фирма серьёзная.). Или это что-то другое? Из-за сбоя компьютера обновление дошло не до всех. Сбросьте свой емейл в личку или на почту. Ручная проверка через браузер показывает то-же самое. Кстати, сейчас можно использовать прокси из встроенного проксичекера и своих прокси. Спасибо неравнодушным, кто хочет улучшений.

Можно сделать проверку прокси через другой сервис или средствами Зенно, чтобы ни от кого не зависеть.

Можете проверить чекер https://hidemy.name/ru/proxy-checker/ и отписаться.

Чуть позже выложу видео парсинга прокси из встроенного в Зеннопостер проксичекера (напишите, нужно это или нет).

Вот проверка через обычный браузер. Что-то у них сломалось, надеюсь, ненадолго. Такое висит уже целый день.

Можно сделать проверку прокси через другой сервис или средствами Зенно, чтобы ни от кого не зависеть.

Можете проверить чекер https://hidemy.name/ru/proxy-checker/ и отписаться.

Чуть позже выложу видео парсинга прокси из встроенного в Зеннопостер проксичекера (напишите, нужно это или нет).

Вот проверка через обычный браузер. Что-то у них сломалось, надеюсь, ненадолго. Такое висит уже целый день.

Последнее редактирование:

StarLight

Пользователь

- Регистрация

- 06.04.2017

- Сообщения

- 337

- Реакции

- 9

- Баллы

- 18

Поэтому я и говорю что нужно использовать встроенный алгоритм проверки уникальности, чтобы не надеятьсяЧто-то у них сломалось, надеюсь, ненадолго. Такое ваисит ужу целый день

StarLight

Пользователь

- Регистрация

- 06.04.2017

- Сообщения

- 337

- Реакции

- 9

- Баллы

- 18

приятно познакомитьсябыл лузером, так и останешся

конечно без меня, скоро выкачу пабликаналог. опенсорснибудь без тебя

буддь здоров

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

И тебе привет, старлаут

Неоднократно было

Неоднократно было

Всё работает чётко. я неоднократно объяснял, что нужно использовать Опен Сервер на своём компьютере - то, что обработчик работает через раз на непонятном хостинге не говорит, что он работает неправильно.

Скрипт на хостинге. И в scraper и в настройках проекта менял все и я так понимаю через раз работает

StarLight

Пользователь

- Регистрация

- 06.04.2017

- Сообщения

- 337

- Реакции

- 9

- Баллы

- 18

...и пять по английскомустарлаут

как же ты софт пишешь по eng таким скилом

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Забей, это был стёб. Ну и вот тебе, для... (сам придумаешь) - http://www.alleng.ru/d/rusl/rusl683.htm. Блядь, ты следишь за мной?http://www.alleng.ru/d/rusl/rusl683.htm

Последнее редактирование:

ibelieve

Client

- Регистрация

- 24.12.2012

- Сообщения

- 250

- Реакции

- 95

- Баллы

- 28

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Извиняюсь, запустил TeamViewer, он попросил обновиться и компьютер ушел в синий экран. Только сейчас удалось восстановить систему, нужно бы переустановить уже давно, но слишком много программ требует перепривязки после переустановки, придется пока так. Если ещё актуально, напишите на почту.Судя по нестандартным ошибкам даже из скриншота, что-то у вас не так. Не в моих правилах, но давайте я посмотрю через TeamViewer.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Ну да, типа хрума, зенно и т.д. Иди лучше свою админку доделай.чужие программы требуют перепривязки. привет матёрым кодерам

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Ребята, эти шаблоны должны быть у вас маст хэв, все темы дохнут, а Вебархив вас будет кормить до конца жизни.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

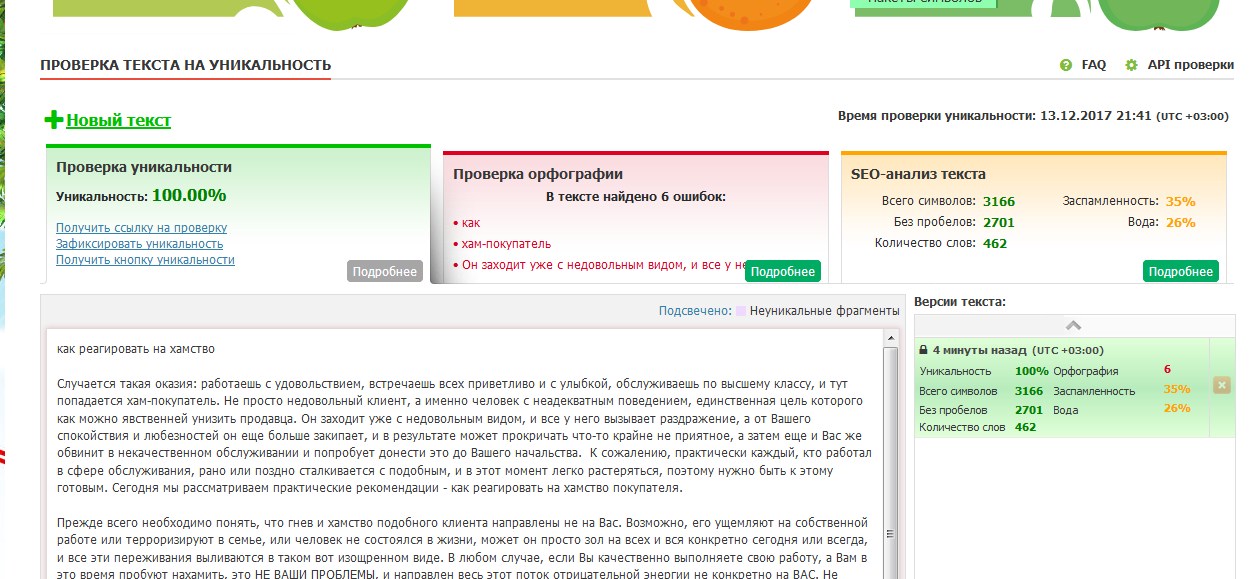

Обновление проверки на плагиат через Text.ru и Content-watch.

Сейчас в приоритете использование встроенного проксичекера со своими источниками. Как работать с чекером, смотрите в справке Зеннопостер.

На данный момент логика такая - берем прокси из проксичекера (сейчас приоритет сместился именно на него, спасибо пользователям, которые предлагают идеи, как им будет более удобно работать), затем проверяет файл My_proxys на наличие прокси (если у вас есть список своих прокси), и затем, если ничего не нашлось, включается резервный вариант - забрать прокси онлайн и проверить их на работоспособность.

Но в связи с тем, что чекер https://hidemy.name/ru/proxy-checker/ стал периодически подвисать, будет добавлен ещё один резервный вариант, который включится, если ничего не сработает. Повторяю, что это всё резервные варианты - сейчас приоритет у встроенного проксичекера с вашими паблик-источниками (которые у всех свои, в этом и смысл).

Завтра напишу помощь и всем разошлю новый вариант проверки на уникальность.

P.S.

Сейчас внезапно именно в декабре у всех свадьбы, дни рождения, похороны, Новый год, поэтому, если я кому то где то что то не то написал и спросил, прошу отнестись с пониманием. Больше так делать не буду. Хотя ничего не обещаю.

Сейчас в приоритете использование встроенного проксичекера со своими источниками. Как работать с чекером, смотрите в справке Зеннопостер.

На данный момент логика такая - берем прокси из проксичекера (сейчас приоритет сместился именно на него, спасибо пользователям, которые предлагают идеи, как им будет более удобно работать), затем проверяет файл My_proxys на наличие прокси (если у вас есть список своих прокси), и затем, если ничего не нашлось, включается резервный вариант - забрать прокси онлайн и проверить их на работоспособность.

Но в связи с тем, что чекер https://hidemy.name/ru/proxy-checker/ стал периодически подвисать, будет добавлен ещё один резервный вариант, который включится, если ничего не сработает. Повторяю, что это всё резервные варианты - сейчас приоритет у встроенного проксичекера с вашими паблик-источниками (которые у всех свои, в этом и смысл).

Завтра напишу помощь и всем разошлю новый вариант проверки на уникальность.

P.S.

Сейчас внезапно именно в декабре у всех свадьбы, дни рождения, похороны, Новый год, поэтому, если я кому то где то что то не то написал и спросил, прошу отнестись с пониманием. Больше так делать не буду. Хотя ничего не обещаю.

Последнее редактирование:

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Поступило предложение совместить парсинг текста и проверку на уникальность. Такой комбайн - берется несколько статей с домена и проверяется на уникальность, если уникальность высокая, то парсятся все статьи, иначе проверяется следующий домен. Она будет идти в дополнение, возможно, кому-то так будет удобнее.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

У вас должна быть последняя версия OpenServer. Или залейте скрипт на хостинг, такая ошибка бывает, когда не хватает библиотеки на локальном сервере.А вот это ошибка почему выскакивает?

Warning : DOMElement::setAttribute(): ID readability-content already defined in C:\Users\root\Desktop\OpenServer\domains\localhost\libraries\readability\Readability.php on line 697

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Готова резервная проверка прокси, если чекер по каким-то причинам не будет работать. Разошлю завтра, нужно протестировать на объемах. Также готова помощь, многое переписано и добавлено. Можно её скачать сейчас.

Насчет совмещения скачивания текста и выборочной проверки на уникальность - возникли неожиданные технические проблемы, хотя, казалось бы - всё очень просто; причем такие, что дальнейшая разработка о совмещении под вопросом, так-как не имеет смысла. Попробуем разобрать некоторые:

Берем несколько статей и проверяем на уникальность - сразу проблема - нужно взять несколько ссылок и прогнать их через фильтрацию, чтобы на начальном этапе отсечь мусор, вероятность, что из этих нескольких ссылок мусором окажутся все, запредельная. Значит, это нужно учесть - создание лишних списков, чтобы не затронуть основной, логика, циклы и т.д. Дальше, отфильтровали ссылки и пошли брать текст для проверки - вот только то, что есть ссылка, значит, будет текст, с Вебархивом не работает - этот текст он давно мог просто удалить, потребуется проверка через снепшоты, а это лишний запрос и время с, наверняка, нулевым результатом.

Дальше ещё веселее - учет уника и неуника. Есть большая вероятность, что из оставшихся на проверку 4-5 статей могут оказаться уником, а весь остальной сайт копипастой и наоборот. Данные придется хранить в памяти плюс особо важные писать в файлы конфигурации. Ещё прокси - они могут попасться крайне медленными и то время, за которое скачался бы текст с сайта, будут проверены 3-4 статьи (прокси и загруженность сервиса, что неконтролируемо).

Не менее важно, что всё учесть невозможно, и одна неучтенная ошибка разбалансирует всю систему, после чего баги полезут как тараканы со всех щелёй. Придется всё это тестировать и отлаживать на ходу, что неприемлемо - получится слишком громоздко.

В принципе, все шаблоны открыты и вы можете подогнать это всё для себя, и тестировать также на себе. Я ещё подумаю, как это всё правильно сделать, но, по-моему, всё оказалось гораздо сложней. Это всё на опыте, я знаю, что обязательно произойдет что-то неучтенное и нестандартное.

Да, лучше работать на своих прокси, даже пабликах. Проверка - один поток - одна папка, чтобы не было пересечений, что будет при пересечении потоков, без понятия, но что-то будет.

Да, и поаккуратнее с восстановлением сайтов - если видите, что текст очень хороший, но на скачивание его слишком много - значит, там залит дорвей и сайт просто бросили. Лучше отсекать текст.

Насчет совмещения скачивания текста и выборочной проверки на уникальность - возникли неожиданные технические проблемы, хотя, казалось бы - всё очень просто; причем такие, что дальнейшая разработка о совмещении под вопросом, так-как не имеет смысла. Попробуем разобрать некоторые:

Берем несколько статей и проверяем на уникальность - сразу проблема - нужно взять несколько ссылок и прогнать их через фильтрацию, чтобы на начальном этапе отсечь мусор, вероятность, что из этих нескольких ссылок мусором окажутся все, запредельная. Значит, это нужно учесть - создание лишних списков, чтобы не затронуть основной, логика, циклы и т.д. Дальше, отфильтровали ссылки и пошли брать текст для проверки - вот только то, что есть ссылка, значит, будет текст, с Вебархивом не работает - этот текст он давно мог просто удалить, потребуется проверка через снепшоты, а это лишний запрос и время с, наверняка, нулевым результатом.

Дальше ещё веселее - учет уника и неуника. Есть большая вероятность, что из оставшихся на проверку 4-5 статей могут оказаться уником, а весь остальной сайт копипастой и наоборот. Данные придется хранить в памяти плюс особо важные писать в файлы конфигурации. Ещё прокси - они могут попасться крайне медленными и то время, за которое скачался бы текст с сайта, будут проверены 3-4 статьи (прокси и загруженность сервиса, что неконтролируемо).

Не менее важно, что всё учесть невозможно, и одна неучтенная ошибка разбалансирует всю систему, после чего баги полезут как тараканы со всех щелёй. Придется всё это тестировать и отлаживать на ходу, что неприемлемо - получится слишком громоздко.

В принципе, все шаблоны открыты и вы можете подогнать это всё для себя, и тестировать также на себе. Я ещё подумаю, как это всё правильно сделать, но, по-моему, всё оказалось гораздо сложней. Это всё на опыте, я знаю, что обязательно произойдет что-то неучтенное и нестандартное.

Да, лучше работать на своих прокси, даже пабликах. Проверка - один поток - одна папка, чтобы не было пересечений, что будет при пересечении потоков, без понятия, но что-то будет.

Да, и поаккуратнее с восстановлением сайтов - если видите, что текст очень хороший, но на скачивание его слишком много - значит, там залит дорвей и сайт просто бросили. Лучше отсекать текст.

Вложения

Последнее редактирование:

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Сбросьте id ошибки, так ничего не понятно. Если бесшаблонный парсер стоит на сервере, возможно, из-за пинга просто не успевает отвечать. Установите новую версию Open Server у себя. Может, слишком загружен процессор или нехватка памяти.Ошибка лезет, что значит?

Последнее редактирование:

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

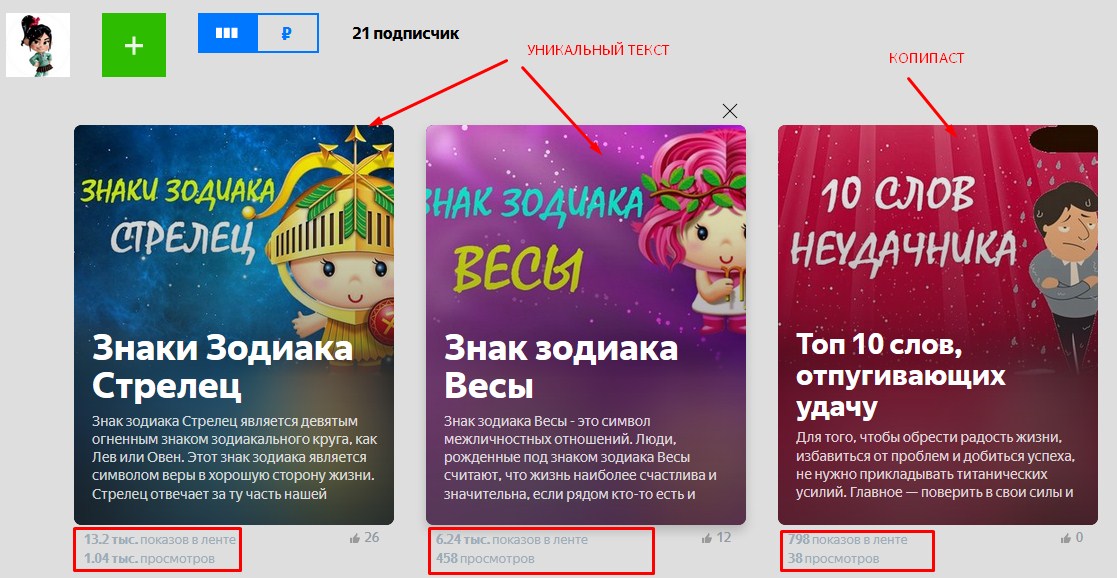

С Дзеном усиленно никто не работал? Попробовал, что-то слабовато. Хотел запулить текстов из Вебархива - сейчас там жестко, нужен только уникальный текст - https://zen.yandex.ru/media/id/5989816de86a9e47babe5719.

Привет!С Дзеном усиленно никто не работал? Попробовал, что-то слабовато. Хотел запулить текстов из Вебархива - сейчас там жестко, нужен только уникальный текст - https://zen.yandex.ru/media/id/5989816de86a9e47babe5719.

Посмотреть вложение 25362

Отпиши, пожалуйста, в ЛС (на счет покупки шаблона)

- Статус

- В этой теме нельзя размещать новые ответы.

Кто просматривает тему: (Всего: 0, Пользователи: 0, Гости: 0)

Поделиться: