Вы используете устаревший браузер. Этот и другие сайты могут отображаться в нём некорректно.

Вам необходимо обновить браузер или попробовать использовать другой.

Вам необходимо обновить браузер или попробовать использовать другой.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Так в самом редакторе вордпресс текст отредактируй. Либо вставляй без форматирования

WebArchiveMastersV4.1

- Теперь, пока текст не спарсится, проверять на уникальность не будет

- При остановке, если включена проверка текста, парсинг будет отключен и включена проверка текста, после полной проверки папка будет перемещена в директорию "ReadyText"

BobiK

Новичок

- Регистрация

- 15.12.2018

- Сообщения

- 18

- Реакции

- 1

- Баллы

- 3

WebArchiveMastersV4.1

Вечером разошлю.

- Теперь, пока текст не спарсится, проверять на уникальность не будет

- При остановке, если включена проверка текста, парсинг будет отключен и включена проверка текста, после полной проверки папка будет перемещена в директорию "ReadyText"

Я у вас купил черз сайт плати.ру. Версия 3.3. Мне полагаются обновления?

В некоторых тестах есть фраза источник: , можно ли убрать эти тексты в "шлак", так, как они зачастую не уникальные с вероятностью 99%

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

ДаЯ у вас купил черз сайт плати.ру. Версия 3.3. Мне полагаются обновления?

В некоторых тестах есть фраза источник: , можно ли убрать эти тексты в "шлак", так, как они зачастую не уникальные с вероятностью 99%

Добавить сюда:

Должно быть так - источник: или источник -, так-как проверка идет по полному совпадению. Регистр тоже важен: источник: и Источник: не одно и тоже. Если добавить просто источник, то в шлак улетит весь текст, где есть это слово.

WebArchiveMastersV4.1

Вечером разошлю.

- Теперь, пока текст не спарсится, проверять на уникальность не будет

- При остановке, если включена проверка текста, парсинг будет отключен и включена проверка текста, после полной проверки папка будет перемещена в директорию "ReadyText"

Ответьте пожалуйста, можно ли в моем случае что-то сделать? Не работает часть функционала, основная это парсинг сайтов. Версия зенки 5.11.6.0, на демке 5.25.0.0 все работает, т.е. это вопрос версии. Можно ли мне это каким то образом исправить? что то может скачать или еще что-то? Или мне поможет только обновление моей версии?

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Посмотреть вложение 34548 Посмотреть вложение 34549

При добавление в поле чистка от мусора такие слова как (18+,+1выдает ошибку.

И далее крашится не раскидав все по файлам.

После просто берет новый домен. И все по кругу.

Сделано под версии ZennoPoster RU 5.17.1.0 - ZennoPoster RU 5.17.2.0. Как самые стабильные. ZennoPoster RU 5.17.1.0 вроде как лучше.Ответьте пожалуйста, можно ли в моем случае что-то сделать? Не работает часть функционала, основная это парсинг сайтов. Версия зенки 5.11.6.0, на демке 5.25.0.0 все работает, т.е. это вопрос версии. Можно ли мне это каким то образом исправить? что то может скачать или еще что-то? Или мне поможет только обновление моей версии?

5.11.6.0 слишком старая, на 5.25.0.0 не тестировалось, далеко не у всех последние версии, поэтому был выбран компромисс. А таких ошибок я не видел ((18+,+1). Возможно, регулярное выражение вставлялось, я таких опытов не проводил.

P.S.

Отправил всем.

Последнее редактирование:

Fantomass

Client

- Регистрация

- 13.04.2016

- Сообщения

- 89

- Реакции

- 42

- Баллы

- 18

А зачем при проверке текста на уникальность сначала загружается профиль из папки profile, а затем очищается UserAgent?Отправил всем.

Yolbert_Shantry

Client

- Регистрация

- 01.12.2018

- Сообщения

- 13

- Реакции

- 2

- Баллы

- 3

Спасибо за обновление.

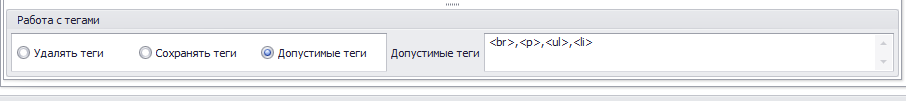

Возможно ли сделать частичное сохранение html тегов разметки?

Пример из Datacol на скрине ниже.

Это бы очень облегчило работу при массовом импорте.

Возможно ли сделать частичное сохранение html тегов разметки?

Пример из Datacol на скрине ниже.

Это бы очень облегчило работу при массовом импорте.

Тогда перед чисткой от мусора производить замену спец символов желательно было бы.Сделано под версии ZennoPoster RU 5.17.1.0 - ZennoPoster RU 5.17.2.0. Как самые стабильные. ZennoPoster RU 5.17.1.0 вроде как лучше.

5.11.6.0 слишком старая, на 5.25.0.0 не тестировалось, далеко не у всех последние версии, поэтому был выбран компромисс. А таких ошибок я не видел ((18+,+1). Возможно, регулярное выражение вставлялось, я таких опытов не проводил.

Посмотреть вложение 34555

P.S.

Отправил всем.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Без истории браузера текст.ру сбрасывал проверку. Возможно, что-то тестировали. С подменой данных в профиле нужно ещё поработать.А зачем при проверке текста на уникальность сначала загружается профиль из папки profile, а затем очищается UserAgent?

Да, это несложно. Будет позже, после обкатки.Спасибо за обновление.

Возможно ли сделать частичное сохранение html тегов разметки?

Пример из Datacol на скрине ниже.

Это бы очень облегчило работу при массовом импорте.

Посмотреть вложение 34562

Не видел там спецсимволов. Скиньте пример.Тогда перед чисткой от мусора производить замену спец символов желательно было бы.

Yolbert_Shantry

Client

- Регистрация

- 01.12.2018

- Сообщения

- 13

- Реакции

- 2

- Баллы

- 3

Было бы очень кстати, т.к. на все, что парсится сейчас, требует много ручного труда.Да, это несложно. Будет позже, после обкатки.

Спасибо!

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

WebArchiveMastersV4.2 alfa

- Устранены баги

- Добавлен поиск по ключевым словам - можно забросить домены и проверять их на наличие нужного текста

- Домены, которые не отвечали на запрос или там было мало текста, теперь удаляются, а не сохраняются.

Пример фильтрации с проверкой - скачать

Пример настройки и помощи - посмотреть

Цена - 600 рублей. Шаблон полностью открытый и без привязок. Если нужно решение по скоростной проверки на уникальность, то +200 рублей.

Вебмани: Z251978534905, R282711380496

Яндекс-Деньги: 410011187505134

Киви - +7 961 999‑51‑37

В понедельник-вторник будет видео по всем функциям, как и что делать, так-как видео уже устарели.

П.С.

Разошлю сегодня вечером.

П.П.С.

Кстати, магазин Вебархива Текстнет вынесли - http://webavtocat.ru. Так-что можно сделать свой, у кого ума хватит.

Вложения

Последнее редактирование:

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Пишите на емейл - footashes@gmail.com. Через пару дней будет полное видео - от и до.Доброго времени суток! footashes, в телеге можно связаться?

BobiK

Новичок

- Регистрация

- 15.12.2018

- Сообщения

- 18

- Реакции

- 1

- Баллы

- 3

Можно вынести в отдельный модуль шаблон, который очищает большой текстовый файл? Иногда парсит большой сайт на 15000 страниц, и очень много дерьмового контента и приходится останавливать парсинг, при этом весь контент находиться в одном файле, а не разбивается по отдельным текстовым файлам, как после обычного окончания процесса, что очень неудобно из него извлекать контент, который нужен.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Нельзя останавливать на полпути, иначе данные не обработаются. Если не хотите обрабатывать большие файлы, для этого есть модуль "дорвей". Также на лету обрабатываются данные по стоп-листу (если есть слова "порно, адали и т.д., эти текста игнорируются.Можно вынести в отдельный модуль шаблон, который очищает большой текстовый файл? Иногда парсит большой сайт на 15000 страниц, и очень много дерьмового контента и приходится останавливать парсинг, при этом весь контент находиться в одном файле, а не разбивается по отдельным текстовым файлам, как после обычного окончания процесса, что очень неудобно из него извлекать контент, который нужен.

Я не зря написал о подготовке видео, так-как большинство не понимает про постобработку текста.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Для тех, кто постит статьи на своем сайте, посмотрите пример группировки правильной семантики на довольно коротких текстах - https://world-mans.ru/otbelit-zuby-v-domashnix-usloviyax.html (https://www.telderi.ru/ru/viewsite/1262342). Если вы просто забрасываете статью на сайт, её никто никогда не увидит. Именно поэтому в Вебархиве миллионы заброшенных сайтов и блогов - люди ночами писали статьи - интересные, с фотографиями и комментариями и получали 10- 50 человек в день. В первую очередь семантическое ядро - посмотрите в статье - основной запрос в h1, размазанный в title, заголовки и подзаголовки с ключами, хвосты раскиданы по всей статье.

Я так делаю давно, также делает этот вебмастер, тот же принцип у Пузата. Без ключевых запросов с группировкой статья ранжироваться просто не будет. Робот просто не поймет, как ему ранжировать.

P.S.

Есть идея создания автоматизированного семантического ядра для статей. Хотя бы по 40 параметрам - первый из них - усложненная формула KEI = p²/u. Затем проверка конкурентности статьи (по мутаген, кто знает примерную формулу, скинте на емейл) и ещё по 40 параметрам.

Альфа версия будет готова чарез пару недель.

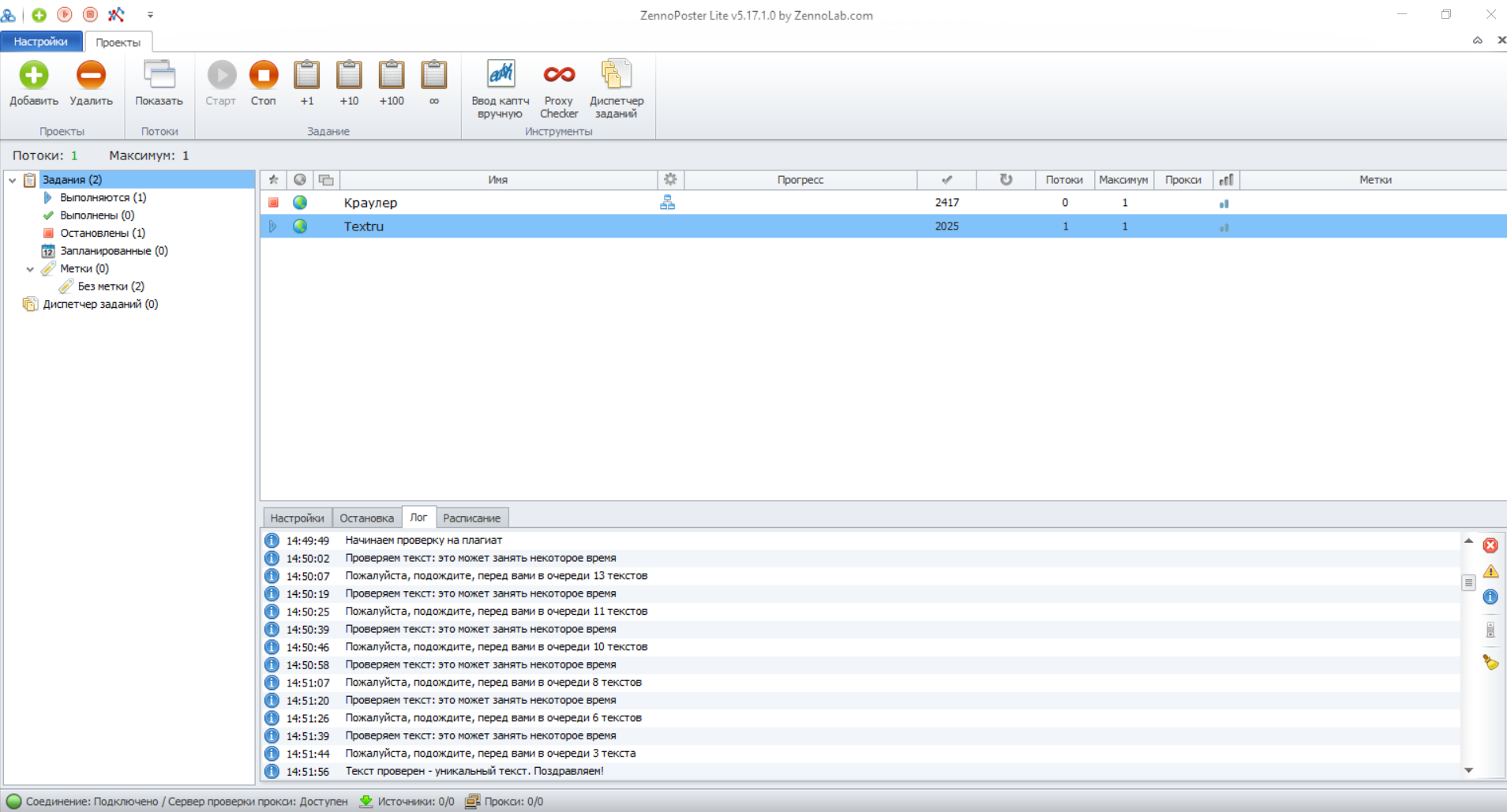

За 3 суток напарсено и проверено текстов:

Я так делаю давно, также делает этот вебмастер, тот же принцип у Пузата. Без ключевых запросов с группировкой статья ранжироваться просто не будет. Робот просто не поймет, как ему ранжировать.

P.S.

Есть идея создания автоматизированного семантического ядра для статей. Хотя бы по 40 параметрам - первый из них - усложненная формула KEI = p²/u. Затем проверка конкурентности статьи (по мутаген, кто знает примерную формулу, скинте на емейл) и ещё по 40 параметрам.

Альфа версия будет готова чарез пару недель.

За 3 суток напарсено и проверено текстов:

Последнее редактирование:

livetreider

Client

- Регистрация

- 06.11.2015

- Сообщения

- 17

- Реакции

- 4

- Баллы

- 3

Хотелось бы узнать когда вы пришлёте парсер, а то я ещё вчера денежку перевёл на почту написал, а в ответ тишина.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Был в отъезде. Отправил всем.Хотелось бы узнать когда вы пришлёте парсер, а то я ещё вчера денежку перевёл на почту написал, а в ответ тишина.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

WebArchiveMastersV4.3

Разошлю завтра к обеду.

Отправил всем.

Завтра будет полное пошаговое руководство. Будем разбирать рандомный домен с комментариями (звук будет записан с помощью робота). Пока почитайте помощь, чтобы понимать принцип работы. Также разберем проверку через Текст.ру.

Акция - 3 дня WebArchiveMastersV4.3 за 600 рублей. Это равняется одной статье через РотаПост - именно так я продавал со своего сайта - Ротапост, Миралинкс, ГГЛ - предназначено для владельцев сайтов. Зачем покупать статьи и платить деньги, получается невыгодно.

Как бы вы не жили сейчас, а парсер Вебархива пригодится вам если не сегодня, так завтра. Код открыт, и при желании, вы сможете перенести его принцип на любую платформу.

Сейчас пример с Дзен и небольшой лайфхак.

Статьи с Вебархива хорошо показывают себя на сайтах и Дзене, но они не предназначены для Дзен. Малой кровью сейчас не обойтись. Была идея слива с дзен - использование как дорвейный трафик - кликабельность настолько низкая, что не стоит даже бесплатных текстов.

Поразмышляйте на досуге - кто такие посетители Дзен. Это люди, которые сидят в (на) белом коне\метро\работе. Это люди, которые не будут читать сложные статьи. Они будут читать новости -чтобы быть в курсе, Пикабу и Яплпкалъ. Тематика развлекательная, с блоговыми статьями туда лезть бесполезно. Возникает даже подозрение, что это ботовый трафик.

Ниже вчерашняя моя статья с Дзен - там всё работает совсем по другому.

Это одна статья с Вебархива из сотни - переходы неплохие, покупок ноль.

Палю тему, как работает алгоритм Дзена. Дзен очень сильно сейчас затянул гайки для вебмастеров. Сценарий вашей работы с Дзеном сейчас - сейчас в тренде...

Если интересно, напишу со сценарием, что и как делать. Но придется поработать.

- Пофиксены незначительные баги

- Дополнены различные фильтрации

- Обновлена помощь и сделано пошаговое видео

Разошлю завтра к обеду.

Отправил всем.

Завтра будет полное пошаговое руководство. Будем разбирать рандомный домен с комментариями (звук будет записан с помощью робота). Пока почитайте помощь, чтобы понимать принцип работы. Также разберем проверку через Текст.ру.

Акция - 3 дня WebArchiveMastersV4.3 за 600 рублей. Это равняется одной статье через РотаПост - именно так я продавал со своего сайта - Ротапост, Миралинкс, ГГЛ - предназначено для владельцев сайтов. Зачем покупать статьи и платить деньги, получается невыгодно.

Как бы вы не жили сейчас, а парсер Вебархива пригодится вам если не сегодня, так завтра. Код открыт, и при желании, вы сможете перенести его принцип на любую платформу.

Сейчас пример с Дзен и небольшой лайфхак.

Статьи с Вебархива хорошо показывают себя на сайтах и Дзене, но они не предназначены для Дзен. Малой кровью сейчас не обойтись. Была идея слива с дзен - использование как дорвейный трафик - кликабельность настолько низкая, что не стоит даже бесплатных текстов.

Поразмышляйте на досуге - кто такие посетители Дзен. Это люди, которые сидят в (на) белом коне\метро\работе. Это люди, которые не будут читать сложные статьи. Они будут читать новости -чтобы быть в курсе, Пикабу и Яплпкалъ. Тематика развлекательная, с блоговыми статьями туда лезть бесполезно. Возникает даже подозрение, что это ботовый трафик.

Ниже вчерашняя моя статья с Дзен - там всё работает совсем по другому.

Это одна статья с Вебархива из сотни - переходы неплохие, покупок ноль.

Палю тему, как работает алгоритм Дзена. Дзен очень сильно сейчас затянул гайки для вебмастеров. Сценарий вашей работы с Дзеном сейчас - сейчас в тренде...

Если интересно, напишу со сценарием, что и как делать. Но придется поработать.

Последнее редактирование:

deonisii

Client

- Регистрация

- 23.03.2012

- Сообщения

- 99

- Реакции

- 12

- Баллы

- 8

Не приходят обновления. Полный пакет. Доплачивал 200р, помимо цены за прогу.Был в отъезде. Отправил всем.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Скорее всего, из-за Мейл.ру. Завтра будет новая версия + сценарий работы с Дзен. Дзен сейчас затянул гайки в одностороннем порядке и пояса вебмастеров. Подкину сценарий работы с Дзен - но придется поработать - сейчас всё работает не так, как полгода назад.Не приходят обновления. Полный пакет. Доплачивал 200р, помимо цены за прогу.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Всё должно дойти по представленным данным. В любом случае, эдесь отпишу о рассылке - если не дошло, отправлю в личку. Ваши данные есть, уже проверено. Также здесь опишу тренд работы с Дзен на сейчас. Ну или при рассылке.Яндекс подойдет? Для получения писем. Или лучше gmail ?

HastaLaVista

Client

- Регистрация

- 29.10.2018

- Сообщения

- 164

- Реакции

- 156

- Баллы

- 43

Аналогично. Последний мэйл с обновлениями был с 4.2alfa от 22.12.18. Дальше тишина. В папке Спам пусто, акк ан джимэйле.У меня на почте последняя версия 4.2

4.3 не приходила

Писал на мэйл автору, но ответов тоже не приходит.

Кто просматривает тему: (Всего: 0, Пользователи: 0, Гости: 0)

Поделиться: