Вы используете устаревший браузер. Этот и другие сайты могут отображаться в нём некорректно.

Вам необходимо обновить браузер или попробовать использовать другой.

Вам необходимо обновить браузер или попробовать использовать другой.

WebArchiveMaster - парсер Вебархива

- Автор темы footashes

- Дата начала

- Статус

- В этой теме нельзя размещать новые ответы.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Завтра будет глобальное обновление WebArchiveMaster.

Изменения:

Изменения:

- Названия файлов для подготовки проверки на уникальность теперь имеют название домена

- Уменьшена жесткость фильтрации

- Изменен алгоритм, теперь идет дополнительная проверка по снепшотам, если Архив не дает файл

- Пофиксены недочеты и мелкие ошибки

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Изменения:

Вебмани: R282711380496

Яндекс-Деньги: 410011187505134

В примечании пишите свой емейл.

По акции сейчас всё (WebArchiveMaster - парсер Вебархива + Black Widow Spider + Антиплагиат + Мануал) за 800 рублей.

Уроки и помощь:

http://zennolab.com/discussion/attachments/videouroki-po-shablonam-txt.24187/

http://zennolab.com/discussion/attachments/full-text-rss-pdf.24190/

http://zennolab.com/discussion/attachments/proverka-unikalnosti-cherez-text-pdf.24188/

http://zennolab.com/discussion/attachments/webarchivemasters-pdf.24191/

http://zennolab.com/discussion/attachments/black-widow-spider-pdf.24189/

- Названия файлов для подготовки проверки на уникальность теперь имеют название домена

- Уменьшена жесткость фильтрации

- Изменен алгоритм, теперь идет дополнительная проверка по снепшотам, если Архив не дает файл

- Теперь есть докачка текстов при сбое

- Пофиксены недочеты и мелкие ошибки

Вебмани: R282711380496

Яндекс-Деньги: 410011187505134

В примечании пишите свой емейл.

По акции сейчас всё (WebArchiveMaster - парсер Вебархива + Black Widow Spider + Антиплагиат + Мануал) за 800 рублей.

Уроки и помощь:

http://zennolab.com/discussion/attachments/videouroki-po-shablonam-txt.24187/

http://zennolab.com/discussion/attachments/full-text-rss-pdf.24190/

http://zennolab.com/discussion/attachments/proverka-unikalnosti-cherez-text-pdf.24188/

http://zennolab.com/discussion/attachments/webarchivemasters-pdf.24191/

http://zennolab.com/discussion/attachments/black-widow-spider-pdf.24189/

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

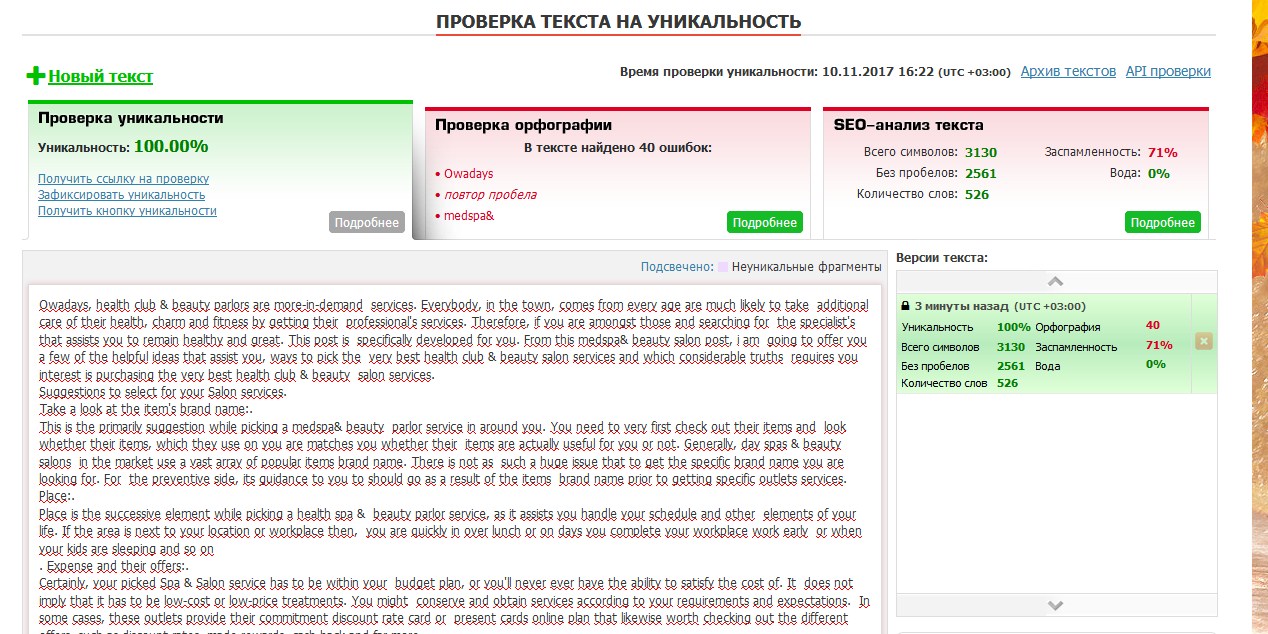

Всем разослал. Примеры текстов для проверки на уникальность, скачанные с помощью WebArchiveMaster на разных языках:

Вложения

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Проверка текста через Content-Watch, используя прокси. Примерный алгоритм:

Программа всё делает автоматически, вмешательство не требуется.

- Парсинг русских прокси.

- Проверка этих прокси на работоспособность (чекинг).

- Берем прокси и переходим на проверку текста (берем текст из папки "База статей").

- После проверки переносим файл из папки "База статей" в папки "Уникальные" или "Копипаст" (в зависимости от проверки).

- Перед каждым файлом пишется процент уникальности - например, Уникальность 0_13% - ваш текст.txt или Уникальность 83_04% - ваш текст.txt

- Добавлена возможность использования своих прокси. Для этого в файл My_proxys вставляете свои прокси, шаблон забирает их и работает с этими прокси, а файл очищает. Если прокси не рабочий, он удаляется и берется другой. Когда все прокси будут отработаны, файл проверяется, и если он пустой, запускается автоматический парсинг и чекинг прокси с hidemy. Как правило, собственные прокси работают на несколько порядков быстрее. В шаблон Textru тоже добавлена возможность использования своих прокси.

Скорость проверки текста зависит от прокси и загруженности сервиса. В моем случае это составляет примерно 50 текстов в час.

Для кого это? Это пригодится копирайтерам, так-как текст.ру самый вменяемый проверяльщик, по моему мнению - я ориентируюсь в своей работе только на него. Новичкам, которые хотят узнать, как зайти на сайт с помощью прокси и где их взять. Также это пригодится тем, кто хочет использовать прокси в своей работе - шаблон позволяет модернизировать логику и сделать на этой базе что угодно, что требует использования прокси - спамер Мой Мир, регистрация почтовых ящиков и т.д.

Также шаблон пригодится как дополнение к парсеру вебархива, так-как для проверки уникальности не требуется капча, а многие стопорятся именно на проверке уникальности.

По акции сейчас всё (WebArchiveMaster - парсер Вебархива + Black Widow Spider + Антиплагиат + Мануал + Content-Watch) за 800 рублей.

Вебмани: R282711380496

Яндекс-Деньги: 410011187505134

В примечании пишите свой емейл.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Нужно искать тематические сайты. Это ручная работа, но я работаю именно так, некоторые садят людей, которые просматривают сайты. Ранее был бум обмена комментариями, и вероятность найти хороший сайт по тематике довольно высока. Разумеется, чем уже тематика, тем сложнее. Я работаю по женской (психология, здоровье, рецепты и т.д.. Но находил довольно много строительных, туристических и другой дорогой тематики. Разумеется, их значительно меньше.Руки и время добрались до запуска. И крайлер и парсинг комментов запустились.

Может подскажите, как быстрее найти доноров в комментах?)

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Для одиночных сайтов можно использовать wayback-machine-downloader - https://github.com/hartator/wayback-machine-downloader. Работает на Руби и позволяет скачать сайт со всей структурой. Или использовать онлайн-сервисы. WebArchiveMaster предназначен в основном для массовой скачки и беспрерывной работе на сервере. WebArchiveMaster берет корни именно с этой программы, но восстановление сайтов показало, что сейчас это гораздо хуже работает, чем парсинг текстов. Нужно внедрение LSI в текст, то есть синонимов, а не прямое вхождение, но использование непрямых ключей тоже никто не отменял. Также перенос на движок стоит денег, в общем, нерационально, это все проверено и опробовано, поэтому лучше забирать текст. Но можете потренироваться.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

StarLight, ты совсем cдурел, поговорить больше не с кем? Сделай лучше нормальные дорвей, пусть там будет хотя-бы 30 калек. На то, что страницы входят в индекс не смотри, рано или поздно они все входят, так ПС обучают свою сеть; главное, дают ли они трафик. Посмотри доргены типа Джако или Пандоры, там есть тонкости, например, генерация CSS с разными названиями для каждого шаблона или разбавление Тайтлов. Вроде мелочи, но Дьявол кроется в деталях. Уникальная текстовка важный фактор, но не главный, дорвеи прекрасно лезут на снипетах и прямой копипасте. И присмотрись к тенденции - LSI, то есть синонимам ключевых слов, сейчас это модно.Как-то по-детски звучит ваш упрёк, но если отвечать конструктивно на вопрос, то систему с функционалом, о котром шла речь в моём первом вопросе, я также реализовывал, причём неоднократно для проектов с различной спецификой.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

О восстановлении сайтов и переносе на CMS

Напишу из своего опыта, почему лучше парсить текст, а не готовый сайт со скриптами, фото, css и т.д, хотя, казалось бы - получить готовый сайт, забросить его на хостинг и получать профит, потом спарсить ещё десять и получать в десять раз больше профита. Очень жаль, но будет совсем не так.

1. Вы спарсили готовый сайт, и нарисовалась первая проблема - нулевая уникальность текста. Такой сайт, скорее всего, не войдет даже в индекс.

2. Адаптивный шаблон. Многие сайты находятся в Вебархиве не один год и заточены под СЕО своего года. Сейчас все поменялось, огромное количество трафика идет со смартфонов и планшетов. Шаблоны старых сайтов под это не приспособлены, а значит, вам придется вручную или за деньги переносить текста с перелинковкой на новый сайт. Это тоже самое, что сделать сайт с нуля.

3. Ключевые слова. Крайне мало текстов используют ключевые слова на уровне 2017 года либо вовсе их не используют - НК, НЧ, СНЧ -хвосты: такие текста никогда не поднимутся выше десятой страницы. Также используются выделения ключей, что в наше время не приемлимо.

4. Сюрпризы в виде шифрованных ссылок, переадресаций, поисковый спам.

5. Дропы. Если вы думаете, что имеет смысл восстановить сайт на его же дропе, вы играете с огнем. На моей памяти, из 30-40 дропов выстреливал, дай бог, один-два. Оставьте дропы дорвейщикам, для них использование дропов целесообразно - жестко проспамить, получить (или не получить) какой-то профит и выбросить его. 99% всех дропов под фильтрами ПС - это может быть и поисковый спам, и обмен комментариями и ещё 1000 причин. Потратите кучу времени, денег для переноса на CMS и оплату хостинга и получите только потерю времени. С восстановлением сайтов и получение какого-то профита с них вы опоздали примерно на 5-6 лет.

На данное время единственно верная стратегия, которую я вывел и использую - покупка 1-2-3 летнего сайта на Телдери, заполнение его уникальным контентом из Вебархива с внедрением ключей и использованием цитат, подзаголовков и прочего СЕО (смотрите выдачу, какие сайты в первой десятке и почему). Такой сайт имеет траст и доверие ПС, и ему прощается то, за что сайт меньше 6-12 месяцев просто выбросят из поиска.

Либо вы продаете пачку уникальных статей на СЕО форумах - покупатель должен знать, что текст из Вебархива, чтобы использовать его как можно быстрее - не вы одни ищете текста.

Можно продавать на биржах текста, но на свой страх и риск, там есть много тонкостей и в любой момент ваш аккаунт могут забанить.

Также можно продавать в магазин Вебархива textnet.ru. Нужно просто связаться с менеджером через форму, регистрироваться не нужно. Сейчас Гугл усложнил Рекапчу, она стала дороже для разгадывания, поэтому актуально проверять через сервисы Антиплагиат и Content-Watch. Сначала быстрая проверка через Content-Watch, потом чистка текста и проверка через Антиплагиат (Text.ru).

Напишу из своего опыта, почему лучше парсить текст, а не готовый сайт со скриптами, фото, css и т.д, хотя, казалось бы - получить готовый сайт, забросить его на хостинг и получать профит, потом спарсить ещё десять и получать в десять раз больше профита. Очень жаль, но будет совсем не так.

1. Вы спарсили готовый сайт, и нарисовалась первая проблема - нулевая уникальность текста. Такой сайт, скорее всего, не войдет даже в индекс.

2. Адаптивный шаблон. Многие сайты находятся в Вебархиве не один год и заточены под СЕО своего года. Сейчас все поменялось, огромное количество трафика идет со смартфонов и планшетов. Шаблоны старых сайтов под это не приспособлены, а значит, вам придется вручную или за деньги переносить текста с перелинковкой на новый сайт. Это тоже самое, что сделать сайт с нуля.

3. Ключевые слова. Крайне мало текстов используют ключевые слова на уровне 2017 года либо вовсе их не используют - НК, НЧ, СНЧ -хвосты: такие текста никогда не поднимутся выше десятой страницы. Также используются выделения ключей, что в наше время не приемлимо.

4. Сюрпризы в виде шифрованных ссылок, переадресаций, поисковый спам.

5. Дропы. Если вы думаете, что имеет смысл восстановить сайт на его же дропе, вы играете с огнем. На моей памяти, из 30-40 дропов выстреливал, дай бог, один-два. Оставьте дропы дорвейщикам, для них использование дропов целесообразно - жестко проспамить, получить (или не получить) какой-то профит и выбросить его. 99% всех дропов под фильтрами ПС - это может быть и поисковый спам, и обмен комментариями и ещё 1000 причин. Потратите кучу времени, денег для переноса на CMS и оплату хостинга и получите только потерю времени. С восстановлением сайтов и получение какого-то профита с них вы опоздали примерно на 5-6 лет.

На данное время единственно верная стратегия, которую я вывел и использую - покупка 1-2-3 летнего сайта на Телдери, заполнение его уникальным контентом из Вебархива с внедрением ключей и использованием цитат, подзаголовков и прочего СЕО (смотрите выдачу, какие сайты в первой десятке и почему). Такой сайт имеет траст и доверие ПС, и ему прощается то, за что сайт меньше 6-12 месяцев просто выбросят из поиска.

Либо вы продаете пачку уникальных статей на СЕО форумах - покупатель должен знать, что текст из Вебархива, чтобы использовать его как можно быстрее - не вы одни ищете текста.

Можно продавать на биржах текста, но на свой страх и риск, там есть много тонкостей и в любой момент ваш аккаунт могут забанить.

Также можно продавать в магазин Вебархива textnet.ru. Нужно просто связаться с менеджером через форму, регистрироваться не нужно. Сейчас Гугл усложнил Рекапчу, она стала дороже для разгадывания, поэтому актуально проверять через сервисы Антиплагиат и Content-Watch. Сначала быстрая проверка через Content-Watch, потом чистка текста и проверка через Антиплагиат (Text.ru).

iskrakovrov

Client

- Регистрация

- 28.03.2015

- Сообщения

- 531

- Реакции

- 171

- Баллы

- 43

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Да, всё остальное за 200 рублей.Для давно купивших парсер вебархива за 500 на остальные продукты есть скидки?

iskrakovrov

Client

- Регистрация

- 28.03.2015

- Сообщения

- 531

- Реакции

- 171

- Баллы

- 43

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Да, те же.Отлично. Перекину в течении дня. Реквизиты вм те же что и были?

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Для Антиплагиат и Content-Watch лучше использовать свои прокси, когда они закончатся, программа начнет собирать прокси автоматически, но качество таких прокси довольно низкое, этот вариант лучше использовать как резервный. Я мог бы добавить чекер различных прокси, но им будут пользоваться все, так-что лучше использовать свои источники, даже паблик.

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Сейчас идет работа над созданием полной HTML-копии сайта со всей структурой в авторежиме - с комментариями и картинками (если они остались). Это позволит выгружать сайт на сервер и сразу прикреплять к нему домен. При желании потом можно будет перенести на CMS со всеми данными (url, meta, tag и т.д.) Или можно просто скачать текст, проверить его на уникальность и использовать по своему назначению. Все купившие WebArchiveMaster - парсер Вебархива получат его бесплатно. Примеры выложу на неделе.

iskrakovrov

Client

- Регистрация

- 28.03.2015

- Сообщения

- 531

- Реакции

- 171

- Баллы

- 43

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Примеры парсинга текста. С помощью методики были найдены свободные дропы (женская тематика), с помощью WebArchiveMaster скачены текста. Домены можно зарегистрировать и использовать как PBN для продвижения своего сайта или добавить текста на трастовый домен. Текста проверены выборочно через Контент Ватч, около 80% уникальны. Контент никак не обрабатывался, проверка текста была выборочная. Кому нужно, может забрать.

Вложения

- Регистрация

- 20.02.2015

- Сообщения

- 1 054

- Реакции

- 440

- Баллы

- 83

Завтра я напишу в топике для тех, кто только что влился в тематику Вебархива. Смотрите видео и читайте внимательно помощь, там всё написано.

Небольшой фрагмент, что будет в топике:

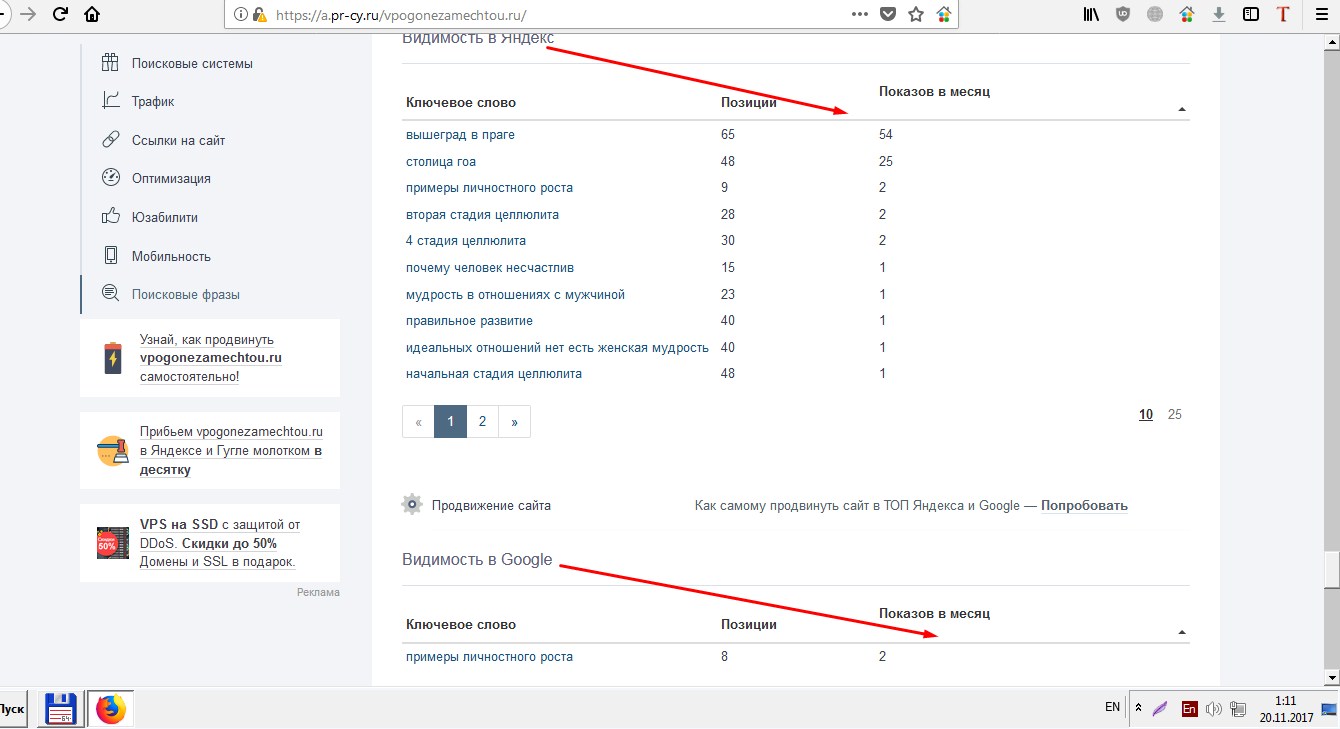

Вот небольшой пример: сайт на текстах Вебархива, примерно 3 месяца, около 49 человек, высокие ПФ - http://vpogonezamechtou.ru. Сайт был создан для прощупывания алгоритмов ПС. Ключевые слова не использовались, упор был на уникальные картинки - затея провалилась. Вердикт: уникализация картинок ни на что не влияет, даже на ПФ, смысла в этом нет.

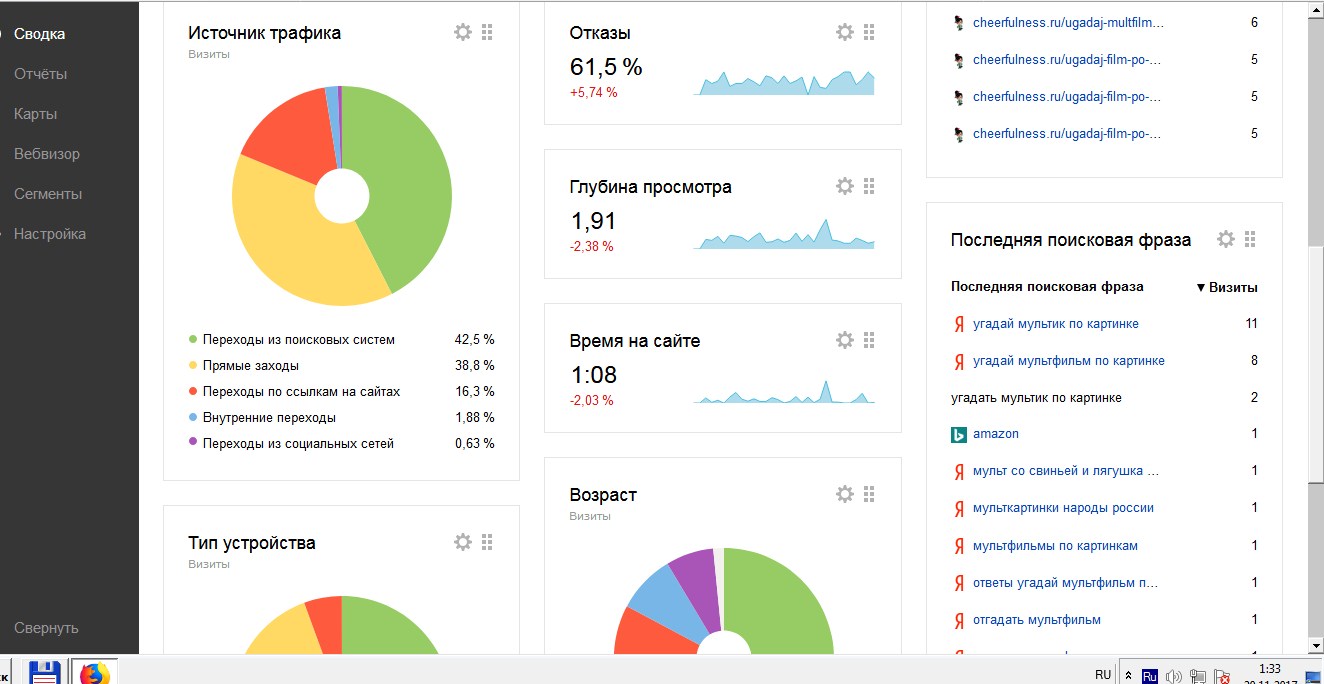

Вот прощупывание поисковых систем, ПС - белый дорвей - http://cheerfulness.ru. Очень высокие ПФ, запутывание ботов ПС, около 40 человек\день. Вердикт - обязательное использование НЧ-НК для своих сайтов, иначе топа не видать, всё уже опробовано на практике. Вчера был залит размноженный текст с ключами - посмотрим на реакцию.

Видео по работе и установке:

Шаблоны рассчитаны на массовую скачку текстов и проверку на плагиат с последующей продажей текстов или использованием для своих сайтов, желательно на сервере.

Небольшой фрагмент, что будет в топике:

Вот небольшой пример: сайт на текстах Вебархива, примерно 3 месяца, около 49 человек, высокие ПФ - http://vpogonezamechtou.ru. Сайт был создан для прощупывания алгоритмов ПС. Ключевые слова не использовались, упор был на уникальные картинки - затея провалилась. Вердикт: уникализация картинок ни на что не влияет, даже на ПФ, смысла в этом нет.

Вот прощупывание поисковых систем, ПС - белый дорвей - http://cheerfulness.ru. Очень высокие ПФ, запутывание ботов ПС, около 40 человек\день. Вердикт - обязательное использование НЧ-НК для своих сайтов, иначе топа не видать, всё уже опробовано на практике. Вчера был залит размноженный текст с ключами - посмотрим на реакцию.

Видео по работе и установке:

Шаблоны рассчитаны на массовую скачку текстов и проверку на плагиат с последующей продажей текстов или использованием для своих сайтов, желательно на сервере.

Последнее редактирование:

- Статус

- В этой теме нельзя размещать новые ответы.

Кто просматривает тему: (Всего: 0, Пользователи: 0, Гости: 0)

Поделиться: